소식 오페라, 로컬 LLM 통합 첫 브라우저로 변신

- BarryWhite

- 조회 수 223

- 2024.04.03. 22:43

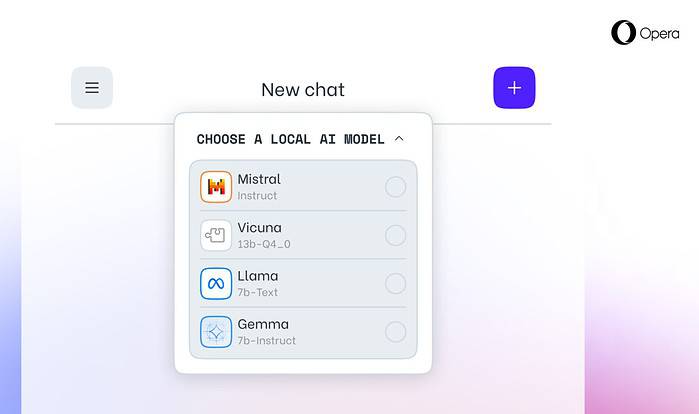

- 오페라Opera는 오늘 오페라 원 개발자 브라우저에 150개의 로컬 대규모 언어 모델(LLM)을 실험적으로 지원한다고 발표했습니다. 이 지원을 통해 사용자는 이제 디바이스에서 강력한 AI 모델을 직접 관리하고 액세스할 수 있으며, 클라우드 기반 AI에 비해 향상된 개인정보 보호와 속도를 제공합니다.

- 이 지원에는 메타의 라마, 비쿠나, 구글의 젬마, 미스트랄 AI의 믹스트랄 등 인기 있는 LLM이 포함됩니다. 로컬 LLM은 서버와 데이터를 공유할 필요가 없으므로 사용자 개인정보를 보호할 수 있습니다. 오페라의 AI 기능 드롭 프로그램을 통해 개발자는 이러한 최첨단 기능을 조기에 이용할 수 있습니다.

- 사용자는 오페라 개발자 사이트를 방문, 오페라 원 디벨로퍼로 업그레이드한 후 원하는 로컬 LLM을 선택하고 다운로드할 수 있습니다. 로컬 LLM은 저장 공간(모델당 2~10GB)이 필요하지만 하드웨어에 따라 클라우드 기반 대안에 비해 속도가 크게 향상될 수 있습니다.

🥇소식게 수호자🥇미게 지박령🥉큰게 좋아🥇미코의 잡담왕🥈유게 공무원🥉할인 경보📝게시판 소유자✨️🥉에로게 심심이

댓글

0